Найдено более 2788 результатов

Вернуться к листу благодарностей

- Февраль 8, 2025, 4:20 am

- Перейти в форум

- Перейти в тему

Стальной II

Аве. Спустя 8 лет, я достаточно уверен в своем курсе и готов выкатить Стальной II . Это более сложный и глубокий распил самодисциплины, фокусировки, приоритезации, с фреймворками, скиллсетами и инвариантами применения всего этого и кучей примеров. Теперь с картинками . Проходить его не имеет смысла ...

- Февраль 8, 2025, 9:24 am

- Перейти в форум

- Перейти в тему

Эра гегемона закончена.

Сегодня официальный конец однополярного мира. Китай запустил термоядерный реактор, который проработал net positive целых 1000 секунд. (Это лучше в 150 раз чем американский аналог). Т.е. технически китайцы примерно на 5 лет впереди. 16,6 минут, это уже близко к границе в 40 минут, при которых эти шту...

- Декабрь 15, 2023, 8:38 pm

- Перейти в форум

- Перейти в тему

ChatGPT тупеет?

kuc1ng писал(а):Намекни нам, если так

Языковая модель обучается на семплах с которыми взаимодействует.

Когда она обучается на научно подготовленных данных - она умнеет.

Когда на запросах интернет-обрыганов с 3мя классам - она деградирует.

- Январь 7, 2025, 2:57 am

- Перейти в форум

- Перейти в тему

ChatGPT тупеет?

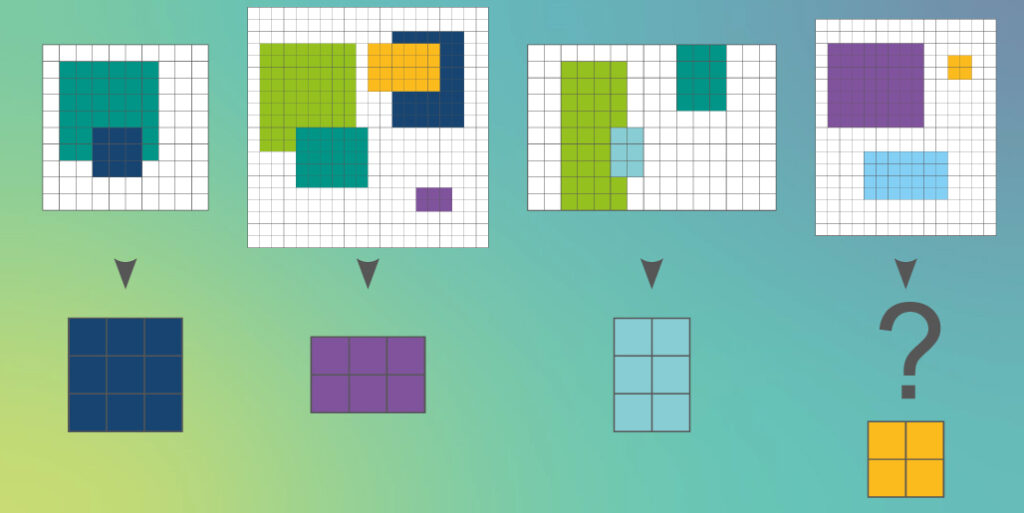

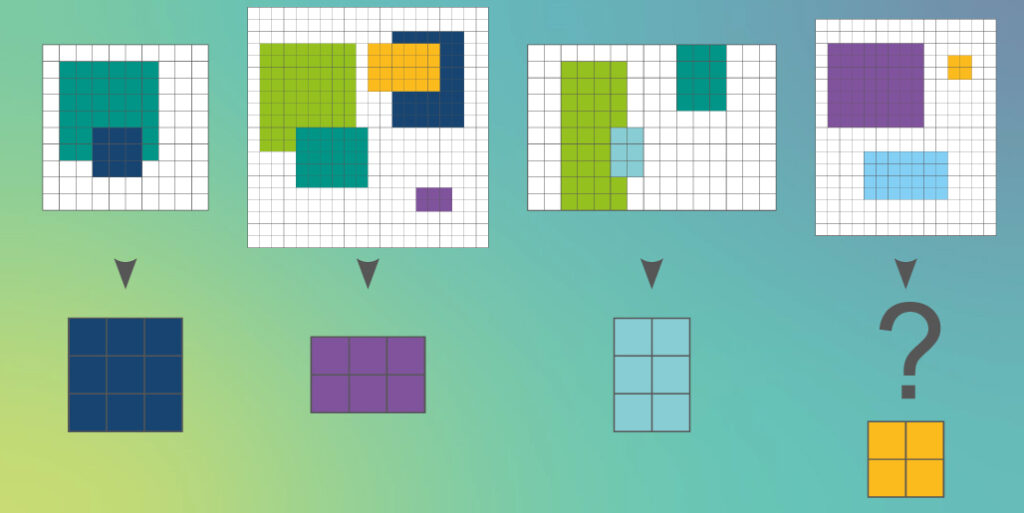

AI не могут пройти даже такой простейший тест:

А также любой другой тест, не встречающийся до этого в литературе.

А также любой другой тест, не встречающийся до этого в литературе.

- Январь 7, 2025, 11:58 pm

- Перейти в форум

- Перейти в тему

ChatGPT тупеет?

А в чем заключается задание? Найти самую маленькую фигуру? Да, выделить самую малую. В этом паттерн. Никакой ИИ не может эту задачу решить. И не сможет с текущими технологиями. Лет 40 мб еще. :sorry: Не очень понятно что этот знак вопроса значит Такую картинку скармливают ИИ, чтобы он знал на что о...

- Январь 8, 2025, 11:58 pm

- Перейти в форум

- Перейти в тему

ChatGPT тупеет?

Все разработчики AI сразу фиксят любые вещи которые видят в интернете, т.к. от этого зависит капитализация их компании, вплоть до 100.000 раз разница может быть. Поэтому нам платят деньги в том числе и затем, чтобы проверить настолько ли "могущественен" искусственный интеллект компаний X, ...

- Январь 11, 2025, 12:52 am

- Перейти в форум

- Перейти в тему

ChatGPT тупеет?

Вот тут говорят что новая модель ГПТ о3 просто в космос рванула по сравнению с предыдущими. Херня, это всё еще трансформер, он может решать только известные задачи. Generative pre-trained transformer имеет все ограничения того что он трансформер просто по своей сути. Это всё корм для инвесторов. Ве...

- Январь 11, 2025, 3:46 pm

- Перейти в форум

- Перейти в тему

ChatGPT тупеет?

Так а существует же овер много задач где нужен трансформер хз,решение неизвестных задач сколько занимают в общих вычислениях? Всё верно, да, существует много таких задач алгоритмических. Другое дело, что никакие задачи с неизвестной компонентной трансформеры решать не могут. Т.е. автомобиль на авто...

- Январь 11, 2025, 5:08 pm

- Перейти в форум

- Перейти в тему

ChatGPT тупеет?

Следующим шагом запилят дополнительный уровень абстракции Не запилят, математика запрещает такие вещи. LLM это 1/10 того что уже известно в математике. :sorry: LLM это просто такое матричное векторное 40.000-мерное пространство, если говорить о gpt-3o. В нем интеллекта не больше, чем в векторном тр...

- Январь 31, 2025, 8:53 pm

- Перейти в форум

- Перейти в тему

ChatGPT тупеет?

Пинтерест давно мертв, из-за того что там даже анатомические референсы нельзя найти, т.к. первые 20 выдач это AI.

Кстати DeepSeek R1 китайский в 11 раз уделывает последний ChatGPT, там такая буча будет, ууух.

Кстати DeepSeek R1 китайский в 11 раз уделывает последний ChatGPT, там такая буча будет, ууух.

- Февраль 3, 2025, 12:39 pm

- Перейти в форум

- Перейти в тему

ChatGPT тупеет?

Это убьет внутренний рынок ИИ в США.

Заградительные меры приводят к отсутствию внешней конкуренции и стагнации в сфере.

Именно поэтому американские автомобили такое говно по сравнению с японскими, немецкими и корейскими.

Заградительные меры приводят к отсутствию внешней конкуренции и стагнации в сфере.

Именно поэтому американские автомобили такое говно по сравнению с японскими, немецкими и корейскими.

- Февраль 3, 2025, 4:00 pm

- Перейти в форум

- Перейти в тему

ChatGPT тупеет?

Кстати эти заградительные меры не сработают, потому что рандомный чел из Филиппин изменит 3 строчки Open Source кода DeepSeek и вот вам PhilippineSeek, на которое ограничения не работают.

Регуляция никогда за софтом не поспеет.

Регуляция никогда за софтом не поспеет.

- Февраль 4, 2025, 1:51 pm

- Перейти в форум

- Перейти в тему

ChatGPT тупеет?

Такая регуляция не работает, эти законы принимают 80-летние деды, не понимающие сути. Можно три строчки поменять и обфусцировать код, не давая опен-сорс. А еще можно автоматизацией каждые полминуты выпускать клон этого ИИ под разными именами, пусть и рандомными. Как ты будешь регулировать то что вых...

- Декабрь 30, 2024, 9:07 pm

- Перейти в форум

- Перейти в тему

Криптовалюты

Оёёй писал(а):я бы тебе посоветовал купить сегодня-завтра на все что ты выделил на крипту,